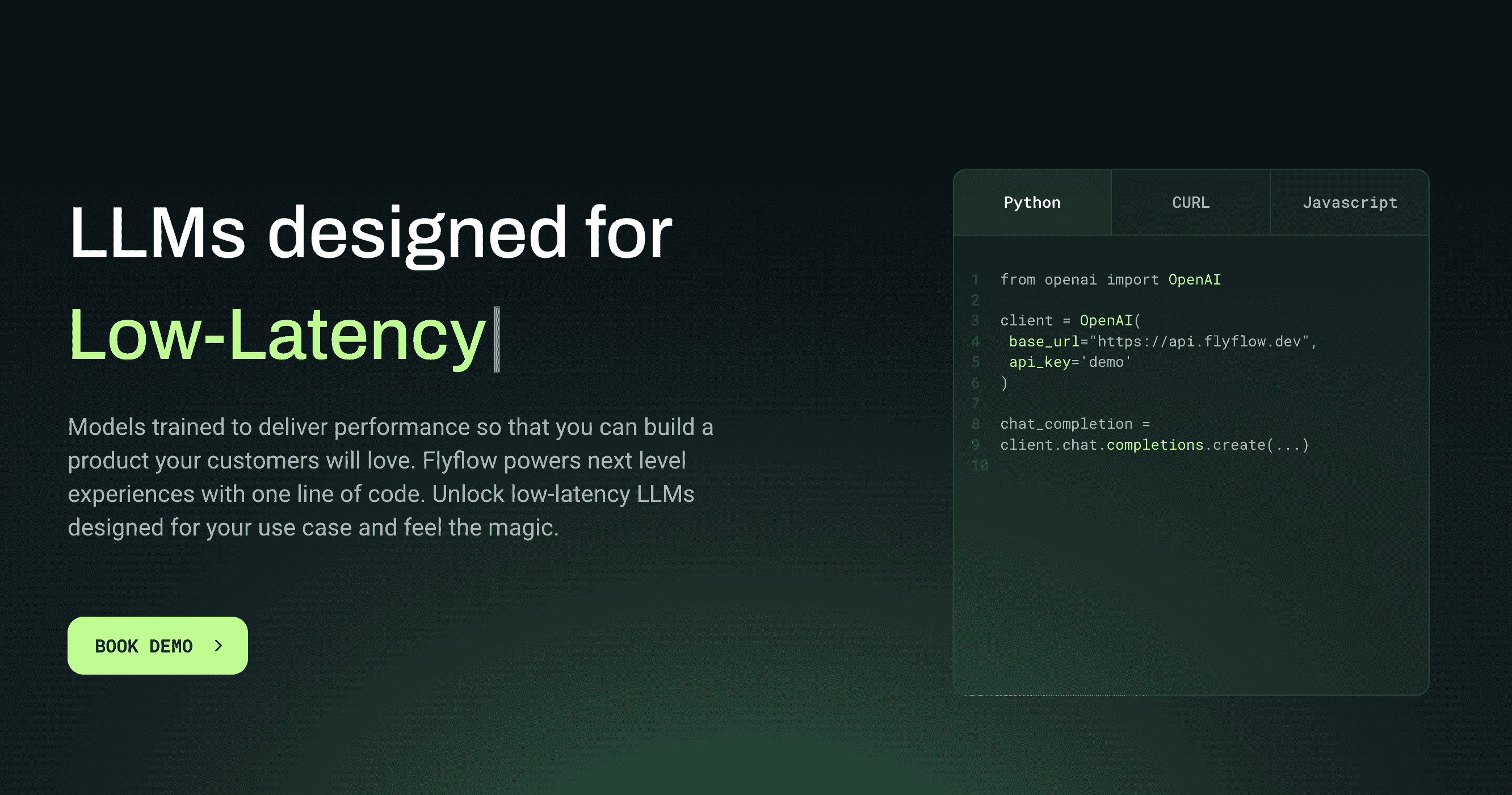

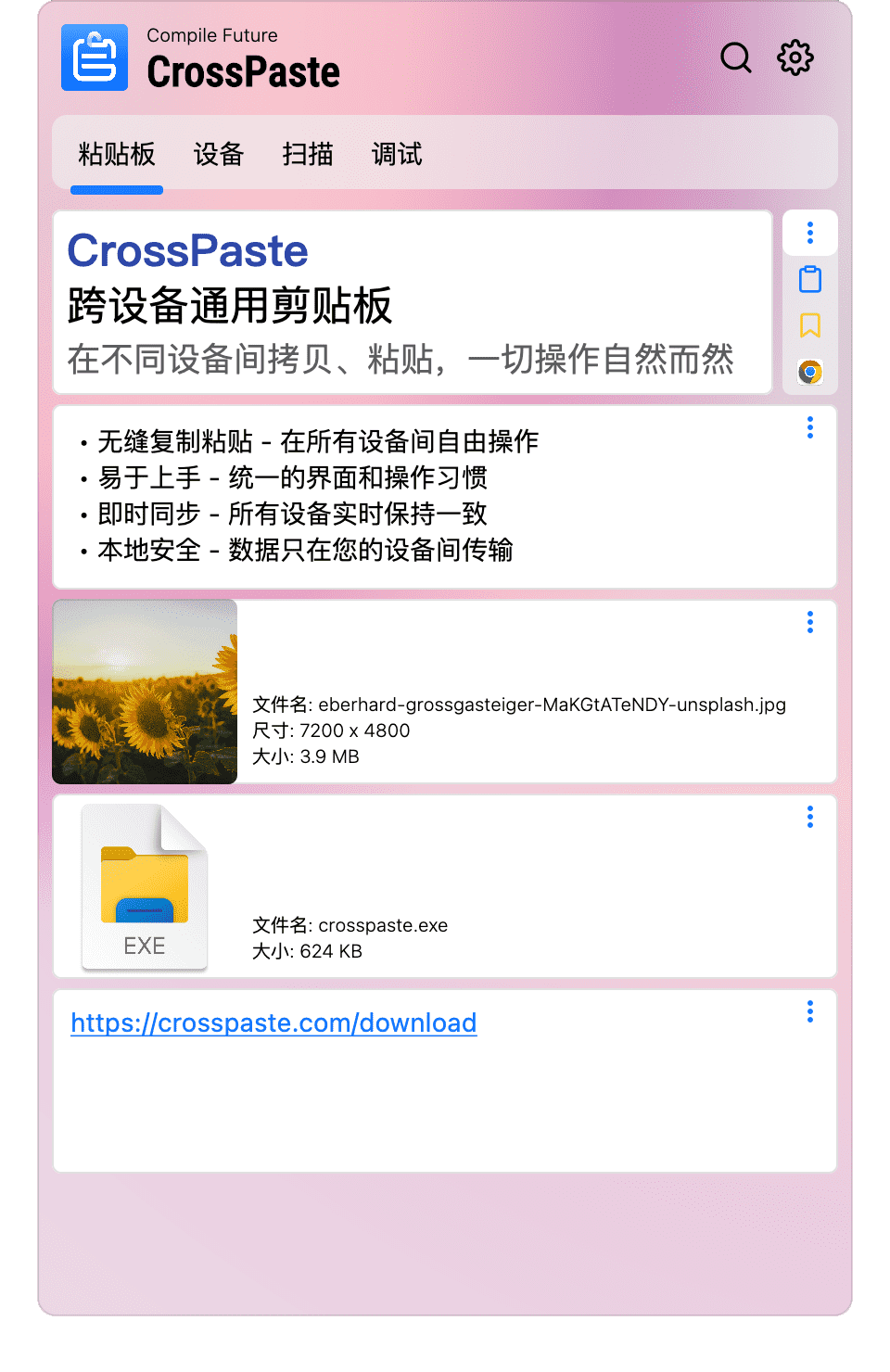

Flyflow一行代码即可解锁低延迟可微调LLM模型

Flyflow一行代码即可解锁低延迟可微调LLM模型

noise介绍

Flyflow是在2024年3月推出的一项针对模型微调API集成的一项服务,Flyflow 是中间件,旨在针对所有LLM的响应、延迟、安全性等进行优化,构建为开源、用 golang 编写的高性能,以及可选的自托管以实现最大的灵活性。

⚠️:截止本文发送时间该服务处于早期运行阶段

GITHUB:https://github.com/flyflow-devs/flyflow

特征

Flyflow 使用 openai 自动跟踪您的查询模式,您可以使用它来微调 mixtral MoE 或 llama 70b,以匹配查询模式上 GPT4 的质量。

推理

Flyflow 通过在许多不同的推理提供程序之间进行负载均衡,可以大幅提高令牌限制和可靠性。

使用 anyscale、together.ai 和 fal 等提供商托管您的自定义精细模型,并使用与 GPT4 相同的质量水平来优化延迟、令牌/秒和速率限制。

这也实现了更高的可靠性,因为如果提供商发生故障,我们可以放弃回退来接载负载。

安全性和可观测性

Flyflow 还可以充当安全中间件,防止敏感信息到达推理提供者(包括 openai 和 microsoft)。

提供易于配置的插件,允许您从查询中过滤 PII,以及帮助您了解组织如何使用 LLM 的高级可观测性工具。

可配置性

Flyflow 被设计为具有极强的可配置性。后端是用 golang 编写的,旨在最大限度地提高性能,同时不影响开发人员的灵活性。

API端点可用模型

| Model Name | API String | Context Length |

|---|---|---|

| GPT4 | gpt-4 | 8k |

| GPT4 Turbo | gpt-4-turbo-preview | 128k |

| GPT3.5 Turbo | gpt-3.5-turbo | 8k |

| GPT3.5 Turbo | gpt-3.5-turbo-0613 | 8k |

| Mistral Large | mistral-large-latest | 32k |

| Mistral Medium | mistral-medium-latest | 32k |

| Mistral Small | mistral-small-latest | 32k |

| Mixtral | mistralai/Mixtral-8x7B-Instruct-v0.1 | 32k |

| Groq Mixtral | groq/Mixtral-8x7B-Instruct-v0.1 | 32k |

| Llama 70b | meta-llama/Llama-2-70b-chat-hf | 4k |

| Groq Llama 70b | groq/llama2-70b | 4k |

| Gemma 7b | google/gemma-7b-it | 8k |

| Groq Gemma 7b | groq/gemma-7b-it | 8k |

| Claude3 Opus | claude-3-opus-20240229 | 200k |

| Claude3 Sonnet | claude-3-sonnet-20240229 | 200k |

| Claude3 Haiku | claude-3-haiku-20240307 | 200k |

发送示例

注意:x-api-key需在header中填入

1 | curl --request GET \ |

评论

匿名评论隐私政策

✅ 你无需删除空行,直接评论以获取最佳展示效果